Эволюция роботов: машины учатся видеть через осязание

Роботы умеют видеть, слышать и учатся трогать. Ученым удалось создать предикативный искусственный интеллект, с помощью которого робот совершенствует свое зрение через тактильные ощущения, и наоборот. Интеграция и взаимное дополнение чувств – привычная функция для человека, но для роботов это в новинку. Перспективы коммерциализации новой технологии очень хорошие.

Поднимите мне веки

Ученые из лаборатории компьютерных наук и искусственного интеллекта (Computer Science and Artificial Intelligence Lab, CSAIL) при Массачусетском технологическом институте (MIT) сообщили о создании системы, обеспечивающей связь и взаимодействие различных чувств. Для начала исследователи связали воедино зрение и осязание.

Опытная установка CSAIL выполнена на базе технологии предикативного искусственного интеллекта (ИИ, AI), который запрограммирован на обучение компьютерному зрению через тактильные ощущения сенсоров. И наоборот: ИИ сможет научить машинное «чувство осязания» распознавать свойства предметов по визуальным данным.

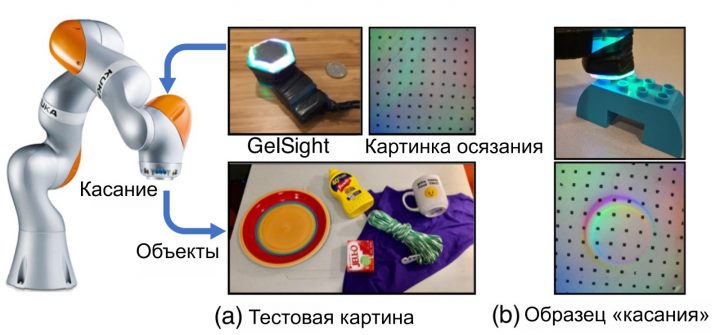

Обучение робота тактильно-визуальным навыкам. манипулятор «видит» визуальный паттерн (серая поверхность с точками) предмета, который предстоит потрогать. Робот изучает деталь конструктора Лего: на увеличенном снимке паттерна показано место касания к «пупырышку» детали.

Источник: CSAIL / MIT

Для человека комплексное взаимное дополнение органов чувств – естественная привычная практика. Нам совершенно необязательно трогать большинство привычных вещей для определения их свойств. В большинстве случаев достаточно лишь взгляда, чтобы определить, что стакан полный, кирпич шершавый, а лестница ведет вверх, а не вниз. И напротив: чтобы определить размер дырки в кармане, совсем необязательно ее видеть – достаточно нащупать ее пальцами. Передвигаться в полной темноте можно осторожными шагами с вытянутыми руками.

Для машин такое совмещение органов чувств очень важно. Например, производственный робот, который пытается переключить рубильник вне поля его зрения: он точно «знает», где расположен этот рубильник, но без когнитивного осязания запросто может цапнуть за руку коллегу-человека и совершить непреднамеренное членовредительство.

«Умное» зрение, в свою очередь, также сможет подсказать роботу, что, например, находящийся перед ним шар совсем необязательно тащить – его будет достаточно просто перекатить. Подобных примеров «из жизни» можно привести тысячи.

В будущем такое взаимопроникновение компьютерных «чувств» может содействовать успешной и «бесшовной» интеграции человека с роботом в производственных или даже бытовых условиях.

Как это работает

В своем исследовании Connecting Touch and Vision via Cross-Modal Prediction ученые из МИТ объединили самообучающийся предикативный ИИ с манипулятором промышленного класса производства компании KUKA Robotics. «Роботизированную руку» оснастили тактильным 3D-сенсором GelSight, также разработанным в МИТ.

Для обучения ИИ использовалась обыкновенная веб-камера, с помощью которой было отснято 12 тысяч видеороликов с примерно двумя сотнями различных объектов повседневного обихода – таких как инструменты, предметы домашнего обихода, ткани и другое.

Далее ученые произвели покадровую разбивку всех 12 000 видеоклипов на отдельные статические кадры. В результате был создан комплект VisGel, в который вошло более 3 миллионов визуально-тактильных пар данных.

Для обучения ИИ исследователи применили набор образов VisGel и алгоритм машинного обучения с помощью так называемых генеративно-состязательных сетей (generative adversarial networks, GAN). Суть алгоритма заключается в одновременном использовании двух нейронных сетей, одна из которых выступает в качестве «учителя» запуская поток контрольных образов, а вторая «учится» отличать оригинальные образы от сгенерированных.

В случае с разработкой исследователей из CSAIL, генеративно-состязательные сети использовались для «обучения» ИИ визуальным навыкам через тактильные свойства, и навыкам осязания через изображения. Две нейронные сети работают друг с другом по принципу конкуренции, как генератор и дискриминатор.

В процессе обучения генератор пытается «обмануть» дискриминатор имитацией реальных изображений. Каждый раз, когда дискриминатор «ловит» генератор на «обмане», ему приходится «обосновывать» свое решение – приводить «доказательства». За счет этого генератор многократно совершенствует свои характеристики.

«Наша модель в состоянии определить ощущение от прикосновения к плоской поверхности или к острому краю, – отметил Юнжу Ли (Yunzhu Li), аспирант CSAIL, соавтор статьи о системе. – Соприкасаясь с объектом «вслепую», наша модель в состоянии предсказать характер взаимодействия исключительно по тактильным ощущениям. Объединение двух чувств может расширить возможности робота и уменьшить объем данных, которые нужны для работы манипуляторов и захвата объектов».

Увидеть прикосновение

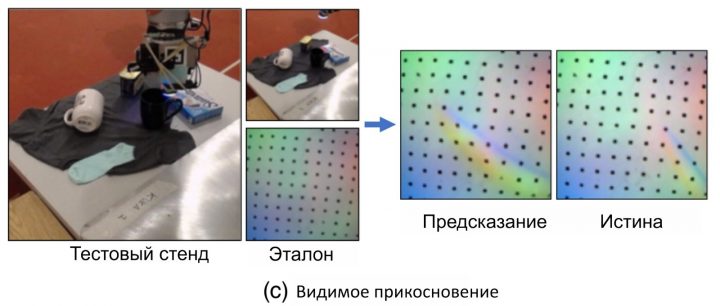

Обучение ИИ оценке тактильных свойств объекта по его изображению начинается с определения области касания, лишь после этого система пытается определить данные о форме и ощущении этой области.

Осязание через зрение: робот пытается «угадать» структуру и форму предмета по его фотографии

Источник: CSAIL / MIT

Этап кодирования системы на предмет соответствия эталонных изображений определенным тактильным свойствам происходит без какого-либо взаимодействия робота с изучаемыми объектами.

После завершения этого этапа манипулятор робота в процессе работы смог запросто определять местоположение объекта и характер касания благодаря сравнению образа в кадре с эталонным изображением в памяти.

Прикоснуться к увиденному

Для «тренировки» компьютерного зрения ученые смоделировали визуальные изображения на базе тактильных данных. После анализа «тактильного» изображения, модель переходила к уточнению формы и структуры материала в месте тактильного контакта. Завершая процесс, ИИ еще раз обращался к эталонному изображению, чтобы закрепить в памяти соответствие полученной «галлюцинации».

Зрение через осязание: робот «наощупь» предсказывает, как выглядит одежда

Источник: CSAIL / MIT

В итоге, например, после изучения тактильных данных ботинка, ИИ мог воссоздать изображение того участка, в котором произойдет тактильный контакт с ботинком.

Перспективы развития технологии

На следующем этапе исследований ученые из MIT намерены выйти за рамки контролируемой среды и улучшить процесс обучения ИИ в процессе сбора и обработки данных в менее структурированных областях.

Еще одним направлением для исследований взаимодействия компьютерного зрения и осязания станет применение новой тактильной перчатки, также разработанной в MIT. С ее помощью ученые надеются расширить ассортимент, габариты и разнообразие свойств тактильных данных.

Ряд сложностей в работе визуально-тактильных алгоритмов еще только предстоит определить и изучить. Например, определение цвета объекта по соприкосновению с ним, или степень мягкости дивана без нажатия на него.

По мнению исследователей, совершенствование алгоритмов с расширенным распределением возможных результатов будет зависеть от создания более качественных моделей неопределенности.

Искусственный интеллект в мире и в России

Сочетание визуального и тактильного восприятия открывает широкие перспективы с точки зрения коммерциализации подобных разработок. В первую очередь такие технологии востребованы в индустрии «социальных роботов» – кибернетических медработников, сиделок для ухода за больными, бизнес-ассистентов и во всех других областях, подразумевающих близкий контакт искусственного разума с человеком.

В последние годы значительный интерес вызывают разработки так называемой «искусственной кожи» для роботов, способной не только имитировать кожу человека, но также в полной мере передавать весь спектр тактильных ощущений. Значительного прогресса в этом направлении удалось добиться группе ученых из Наньянского технологического университета в Сингапуре. Искусственная кожа, созданная в их лаборатории, может быть даже прозрачной, и обладает функцией самовосстановления.

Искусственная кожа

Источник: Department of Materials Science and Engineering / NUS Engineering

Комплект датчиков передает в «мозг» робота данные о структуре и температуре объекта, которого трогал робот, программное обеспечение с функцией ИИ позволяет «учиться на ошибках» и не повторять неудачный опыт, например после разбитого хрупкого стекла или «ожога» от горячего утюга. Помимо сферы социальной робототехники, ученые прогнозируют внедрение технологии в медицине для создания полноценных протезов.

На технологии обучения искусственного интеллекта с комплексной обработкой тактильных и визуальных данных также высок спрос в робототехнике для исследования в труднодоступной и опасной для здоровья человека окружающей среде. Исследователи из Стэнфордского университета разработали подводного человекоподобного робота OceanOne с тактильной обратной связью.

Подводный робот OceanOne

Источник: Osada / Seiguin / Stanford Robotics Lab

Изначально андроид OceanOne создавался для проведения глубоководных исследований, однако ученые также считают, что в перспективе их технологии найдут применение при исследовании космоса, например в процессе изучения Марса или колонизации Луны.

Особенностью OceanOne является наличие двух «рук», стереоскопического «зрения» и множества дополнительных датчиков. Робот оснащен системой из восьми двигателей, которая позволяет перемещаться на больших глубинах и выполнять сложные манипуляции с объектами, при этом визуальная информация и обратная тактильная связь вкупе с машинным обучением позволяют OceanOne реагировать на некоторые события без вмешательства дистанционного оператора.

Информация о подобных российских проектах в Сети представлена весьма скудно, однако интерес к технологиям искусственного интеллекта, машинного обучения и нейронных сетей в России чрезвычайно велик.

Согласно выводам исследования «Бизнес-лидеры в эпоху ИИ» (Business Leaders in the Age of AI), проведенного Microsoft среди 800 топ-менеджеров из Франции, Германии, Италии, Нидерландов, России, Швейцарии, Великобритании и США в начале 2019 года, проникновение технологий искусственного интеллекта в российских компаниях достигло 30%, в то время как в остальных странах показатель в среднем составляет 22,3%. По итогам 2018 года аналитики Accenture Russia оценили объем российского рынка ИИ-технологий в 2,1 млрд рублей. Прогноз на 2021 год – более чем 20-кратный рост отечественного рынка до 48 млрд рублей.