Может ли искусственный разум стать причиной мировой войны

Сразу три громких заявления об использовании искусственного интеллекта в военной сфере прозвучало в этом году. Сначала первый заместитель министра обороны РФ Руслан Цаликов заявил, что Вооруженные силы России уже давно активно используют искусственный интеллект. Затем Командующий сухопутных войск США по вопросам закупок, логистики и технологий Брюс Джетт признался что под контроль ИИ могут переданы некоторые виды вооружения. А буквально на днях крупные корпорации Amazon и Microsoft объявили об участии в тендере по созданию военного ИИ. Эксперты полагают, что эволюция искусственного интеллекта скоро приведет человечество на порог Третьей мировой войны.

От котиков к танкам

Завербовать искусственный интеллект в армию военные мечтают с того самого момента, как первые рукотворные нейроны стали демонстрировать минимальную эффективность. Пока исследования AI находились в зачаточном состоянии, это было невозможно – искусственный разум принимал простейшие решения. Сейчас же мы живем в мире беспилотных автомобилей и электронных помощников, основанных на AI. Фактически это идеальные солдаты для вооруженных сил. Армии любой страны мира не против иметь на своей стороне беспристрастного солдата, который четко выполняет команды, умеет быстро анализировать обстановку и первым нажмет на красную кнопку, случись в мире ядерный Апокалипсис. Фантазии военного блока нашли отражение в голливудских блокбастерах, где самостоятельный и воинственный ИИ загоняет человечество в каменный век.

«ИИ готов изменить характер будущего поля битвы и скорость наращивания угроз, с которыми сталкиваются в современных условиях безопасности. Соединенные Штаты вместе с союзниками и партнерами должны использовать ИИ для сохранения стратегической позиции и победы на будущих полях сражений…»

Из документа Пентагона, «New Strategy Outlines Path Forward for Artificial Intelligence»

Писатель-футуролог Алексей Хохлатов считает, что мир приближается к черте, за которой войной будут руководить машины, а не человек. И вряд ли обойдется без скандалов и пропавших бюджетов. «Конечно же, искусственный интеллект (ИИ) можно использовать в военных целях. Сейчас война уже не та, что была – это битва технологий, далеко не всегда заметная невооруженному глазу. Гражданский сотрудник может заниматься, казалось бы, текущими задачами программирования, сидя за рабочим местом какой-нибудь крупной корпорации или госпредприятия, и не подозревать, что у его разработок есть иное применение, за которым внимательно наблюдают спецслужбы, – говорит он. – Управление пусками ракет, отслеживание поведения летающих объектов, в том числе и в стратосфере, перехват и раскодировка сигналов противника, создание иллюзорных целей, создание помех в аналогичной деятельности противника – далеко не полный перечень задач искусственного интеллекта».

«Руководство Китая, в том числе президент Си Цзиньпин, считает, что быть на переднем крае технологий искусственного интеллекта имеет решающее значение для будущего глобальной военной и экономической конкуренции за власть…».

Из исследования «Понимание китайской ИИ-стратегии».

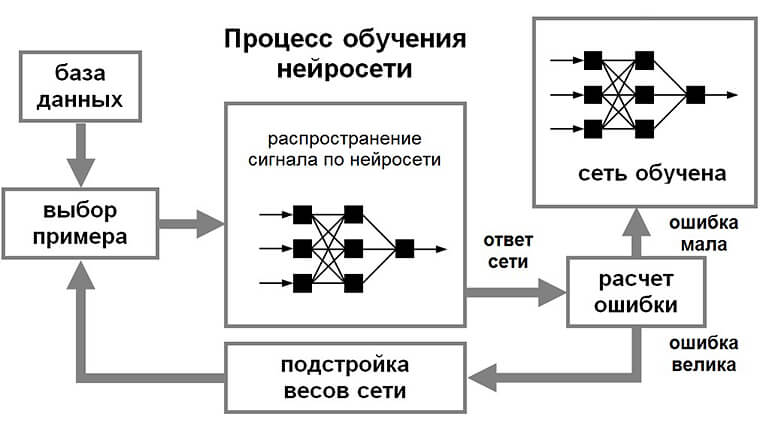

Важно понимать, что ИИ – это не человеческий «мозг в банке». Это программный алгоритм или, как его называют ученые, «черный ящик», который может обучаться. Он может наблюдать, повторять, ошибаться, учиться. Например, черному ящику показывают фотографии с котиками и он, угадывая, ошибаясь, учится узнавать этих пушистых животных. И с каждым разом делает это лучше и лучше. Точно так же ИИ может находить раковые опухоли на снимках, играть в сложные игры. Или анализировать военные карты, данные о расположении частей противника или управлять танком.

У алгоритма нет сознания или понимания, что именно он делает. Более того, разработчики уверены, что ИИ не может внезапно стать разумным или уничтожить людей без участия человека.

Солдат-генерал-полководец

Определить роль ИИ в армии сложно. Политики и футуристы видят в искусственном интеллекте полководца и силу, которая может разом уничтожить весь мир. Член правления НП «Руссофт», создатель и куратор лаборатории искусственного интеллекта в Нижнем Новгороде Павел Адылин уверен, что искусственный интеллект не может стать опасным без участия человека.

«Про это говорит тот же Илон Маск. Он не утверждает, что в «черном ящике» может само собой появиться что-то страшное. Он говорит о том, что человек с дурными намерениями, используя AI (речь идет в первую очередь об алгоритмах обучения с подкреплением), может наделать бед. Если поставить перед программой некую мотивацию, которая будет вредна для человека, система будет учиться решать задачу, целью которой будет зло, и достигать на этом пути все большего успеха», – говорит Адылин.

Простой пример. Разработчики могут создать ИИ, который будет управлять боевым танком. Сам по себе танк будет метко стрелять по целям, которые определит человек, и ездить. То есть ИИ будет специализироваться на задачах, определенных заранее. Определенных человеком, а не самосознанием или мифическим «богом из машины».

Не стоит ожидать от ИИ чудес полководца, который принимает самостоятельные решения. Войной управляют люди. По крайней мере, в ближайшие годы, если верить ведущему специалисту data science в компании Bell Integrator Ивану Прошину. «Если мы говорим о всеобъемлющем управлении войсками, о замене генерального штаба нейронной сетью, то это полная AI-задача, то есть задача создания компьютера, настолько же умного, как человек. В ближайшей перспективе такая задача решена не будет, но прогресс не стоит на месте. Если же говорить о частных случаях, то именно такие задачи уже решает единая система эшелонированной ПВО: целям сопоставляются наиболее подходящие средства поражения в зависимости от степени их угрозы и вероятности поражения».

По мнению Алексея Хохлатова, классической поворотной точкой в развитии ИИ считается момент, когда робот (с ИИ) сможет клонировать самого себя, используя при этом подручный материал, такой как земля, например. Поэтому программные алгоритмы обязаны содержать ограничения, которые не позволят роботам неограниченно «размножаться».

Нанороботы и «умные» снаряды

Оценивая потенциал применения ИИ в армии, практически все эксперты не видят глобальных систем или решений, которые могут изменить расклад сил, как в свое время произошло с атомной технологией. «Потенциал для применения очень широк: от снарядов, самостоятельно корректирующих свой полет для увеличения точности, до систем принятия решений о целесообразности тех или иных военных действий на основе симуляций. Военная сфера имеет огромное количество мест для применения ИИ, их, вероятно, больше, чем это может быть экономически целесообразно. Так, например, есть определенные результаты по разработке самонаводящихся пуль, но вряд ли они в обозримом будущем получат массовое распространение из-за их высокой стоимости», – считает Иван Прошин.

Чем более совершенным будет ИИ, тем меньше вероятность принятия им решений об уничтожении людей, даже если постановка задачи для него будет скрывать такие последствия. Инициация военных действий со стороны ИИ может быть только в случае несовершенства систем или злонамеренно сконструирована людьми, уверен Иван Прошин.

ИИ будет долго выступать на вторых ролях, согласен Алексей Хохлатов. «Элементы искусственного интеллекта уже широко применяются в армиях всего мира. Прежде всего, в трех ведущих военных державах: США, Китае и России. Например, в разведке, при минировании и разминировании территорий, для огневой атаки используются роботы. Также с начала 2000-х ведутся разработки военных нанороботов, способных, словно саранча или вирусы, проникать на территорию противника и блокировать работоспособность его военных и гражданских систем», – рассказывает он.

Есть и другое мнение. Российский предприниматель, основатель и президент группы компаний Cognitive Technologies – российского разработчика ПО и ИТ-решений, заведующая кафедрой инженерной кибернетики НИТУ МИСиС Ольга Ускова указывает, что приоритеты в военных разработках уже поменялись. В военных лабораториях ИИ теперь на первом месте: «Создание высокоинтеллектуальной системы вооружений нового типа на основе эксклюзивных технологий искусственного интеллекта. Изменение парадигмы войны. Ни один американский солдат не должен быть физически под огнем противника на поле боя. Воюют за экранами компьютеров, в безопасной зоне. «Мягкая сила» – демонстрация такого уровня военного преимущества, чтобы никто даже и не рыпался. 31 июля 2018 года Белый дом выпустил меморандум для глав департаментов и агентств №M-18–22 о бюджетных приоритетах R&D на 2019–2020 годы, в котором назвал ИИ первым среди трех высших национальных технологических приоритетов».

Дядя Сэм наблюдает…

Можно только предположить, сколько тратят на разработку умного вооружения армии разных стран. Точные цифры никто не называет, исследования ИИ частично ведутся в гражданской сфере. Можно предположить, что на исследования в области ИИ идет от 10% до 30% процентов оборонного бюджета. Плюс сотни миллионов гражданских денег.

Открытые данные и мнения экспертов свидетельствуют о том, что оборонная стратегия США не делает высоких ставок на ИИ, технологии искусственного интеллекта находятся на первом месте среди приоритетных направлений разработки.

Например, в июне 2018 года Пентагон создал Объединенный центр искусственного интеллекта (JAIC). Название центра – скорее пиар-ход, считает генеральный директор компании Argumentum Дмитрий Жигалов. Эксперт полагает, что никаких разработок в сфере искусственного интеллекта Пентагон не ведет и ждет предложений от гражданской промышленности.

Аргументируя свои выводы, Жигалов цитирует выступление капитана Майкла Канаана, сопредседателя службы по искусственному интеллекту: «Одна из проблем, с которой могут столкнуться подрядчики, – это более дорогие продукты, ориентированные на государственные программы, на безопасность, по сравнению с менее дорогими коммерческими программами. Новое отношение к коммерческим готовым технологиям в рамках сервиса может помочь», – сказал капитан, призывая не считать несекретные гражданские проекты незащищенными.

Проще говоря, успехи по разработке ИИ в коммерческой сфере идут лучше, чем в секретных лабораториях военпрома США. Поэтому задача военного руководства – наблюдать за успехами и использовать лучшие наработки. «Практическая задача, которую сегодня решает JAIC, – прогнозирующее обслуживание. Это скорее эксплуатационная задача, чем управленческая», – поясняет Жигалов. Получается, что Америка только наблюдает за развитием ИИ.

В это легко поверить, если обратить внимание на выступление американского военного чиновника майора Даниэля Тадросса (JAIC). «Мы начали изучать экосистему обслуживания авиации Министерства обороны, которая просто огромна и слишком сложна для любого искусственного интеллекта», – сказал он. То есть искусственному интеллекту де-факто отведена роль рядового солдата или части оборонных систем – ракет, пуль, систем наведения, которые контролируются человеком.

…Россия – делает

А вот в России все ровно наоборот – прорывные технологии рождаются в оборонной промышленности и потом находят применение на «гражданке». Об этом говорил первый заместитель министра обороны РФ Руслан Цаликов. По его словам, военное ведомство Российской Федерации «возглавляет практически все прорывные технологические направления, которые разрабатываются в стране».

«Искусственный интеллект будет развиваться практически во всех сферах деятельности Вооруженных сил. Начнем с того, что отдельные элементы искусственного интеллекта или системы интеллектуального управления в Вооруженных силах уже активно применяются, например в беспилотных системах и робототехнике».

Из выступления министра обороны РФ Руслана Цаликова.

Военный чиновник считает, что «это нормальная ситуация, так как всегда развитие военных технологий опережает развитие технологий гражданских». Получается, что передовые разработки ИИ стоит искать у военных.

В справочнике Министерства обороны в разделе о применении ИИ в обороне можно узнать, что исследования «ведутся по трем основным направлениям: создание систем, основанных на знаниях; нейросистем; систем эвристического поиска, автоматизированных информационных, систем военного назначения – систем поддержки принятия решений должностных лиц и так называемых интеллектуальных систем и образцов вооружения».

В 2017 году вице-премьер России Дмитрий Рогозин заявлял, что к 2025 году в России завершится разработка нового интеллектуального оружия – роботов и беспилотников. Ровно год спустя индустриальный директор кластера обычных вооружений, боеприпасов и спецхимии госкорпорации «Ростех» Сергей Абрамов в ходе конференции «Цифровая индустрия промышленной России – 2018» рассказал о наработках «по созданию военных систем с искусственным интеллектом, который предполагает самообучение оружия».

Как пример, он привел разработку концерна «Калашников» – боевой модуль, который может выделить угрозу и принять решение о ее уничтожении. «Модуль самостоятельно анализирует окружающую обстановку, выделяет угрожающие объекты и сам принимает решение об их уничтожении. При этом алгоритм работы его бортового компьютера базируется на алгоритмах работы человеческого мозга, поэтому модуль способен самообучаться в процессе боевого применения», – отметили в концерне.

Интеллект, которого нет?

Невозможно использовать то, чего на самом деле нет. Искусственный интеллект, который сегодня предлагается на рынке, интеллектом не является, считает Дмитрий Жигалов. «Концепция перцептрона, которая реализуется на базе нейросетей и байесовских сетей, по своей функциональности и сути является искусственным глазом, ухом, носом, но не мозгом. Поэтому такой искусственный интеллект (десятилетия тому назад называемый слабым, а сегодня модно именуемый быстрым) имеет серьезные ограничения по возможному применению. Интеллектуальный армагеддон пока отменяется. Максимум, на что способны современные системы, это автономные действия на тактическом уровне», – отмечает эксперт.

Источник: Investing Notes

По его словам, мыслить глобальнее нынешние системы не способны. Они вообще не думают – в них эта функция не заложена.

«Чтобы понять базовый алгоритм работы современных ИскИнов, достаточно познакомиться с экспериментом «китайская комната». Оборонные проекты современных систем ИскИн правильнее называть «автопилоты» и тогда становится ясно, где они применяются и на что способны. В гражданской сфере совсем недавно автопилот самолетов Boeing показал элементарную неспособность адекватно отрефлексировать ситуацию в условиях поломки датчика, что привело к нескольким катастрофам», – отмечает специалист.

Возможна ли война?

Говоря о возможности новой мировой войны Илон Маск исходит из того, что текущий уровень технического развития ИИ выше, чем уровень регулирования различных аспектов ИИ. Иными словами, законодательно эксперименты с ИИ никак не ограничены.

В этом кроется опасная проблема, считает профессор математики, руководитель лаборатории ИИ в НИУ «Высшая школа экономики» Владимир Крылов. «Я бы ограничивал применение ИИ в военной отрасли, как биологическое и химическое оружие, контролировал, как ядерные вооружения. Создание интеллектуальных систем для самостоятельного управления оружием без участия человека, на мой взгляд, следует рассматривать как преступные действия и ограничивать международными договорами».

Эту проблему понимают крупные технологические компании Google и SpaceX, которые подписали соглашение о неучастии в разработке вооружения с использованием ИИ. «В своих суждениях Илон Маск исходит из того, что текущий уровень развития технологий искусственного интеллекта выше, чем уровень регулирования различных аспектов ИИ. Поскольку технология может быть как мощным инструментом, так и мощным оружием. Он призывает активизировать работы по регулированию ИИ, чтобы не допустить ситуации, когда уже система будет управлять людьми. Однако история показывает, что определенные ограничения на прорывные технологии, например ядерные или ракетные, принимаются на международном уровне только после того, как ими обзаведется несколько стран. Конкуренция за первенство в сфере искусственного интеллекта на национальном уровне, вероятно, даже может стать причиной начала третьей мировой войны», – говорит Иван Прошин.

Скайнет и терминатор

Ученые и политики разных стран спорят, можно ли объединить оборонные системы с искусственным интеллектом разных стран в единую систему. Так они не будут считать друг друга врагами. По словам Алексея Хохлатова, сторонники объединения утверждают, что таким образом удастся достичь хорошей синергии в разработках и создать единое кибернетическое пространство, управлять которым гораздо легче, чем десятком различных сложнейших систем. Противники объединения полагают, что в случае сбоя роботизированные системы уничтожат друг друга, так как они запрограммированы на войну, и в этом случае у человечества есть шанс выжить.

Но в любом случае многие ученые, политики и бизнесмены призывают научные круги всех стран вести разработки с учетом имплементированных в программные коды ограничений всемогущества ИИ. Ведь, как бы фантастично это сегодня ни выглядело, умное вооружение может стать не только инструментом в будущих войнах, но и их причиной.